-

Liczba zawartości

2048 -

Rejestracja

-

Ostatnia wizyta

Typ zawartości

Profile

Blogi

Forum

Kalendarz

Posty dodane przez Revenant

-

-

Ci debile ciągle się nie nauczyli że nie należy irytować i podgryzać Japonii... Która ciągle jest najbardziej nacjonalistycznym krajem demokratycznym... To się może źle skończyć.

Szczególnie biorąc pod uwagę ostatnie kilka lat modernizacji floty Japońskiej oraz łamania konstytucji (obronność, robią więcej niż mogą prawnie ale każdemu to odpowiada więc nikt nie protestuje).

-

Godzinę temu, Rebelmind napisał:

@soda IMHO 3080 12GB RACZEJ taniec już nie będzie. Było info, że NV ma rzekomo wycofywać karty ze sprzedaży, bo wydajnościowo jest zbyt blisko to 3080 Ti i 3090 (czytaj: ludzie nie chcą dopłacać do droższych modeli).

Trzeba bacznie obserwować CO się będzie działo wrzesień / październik, bo jeśli faktycznie wypali scenariusz, iż z Ady tylko 4090 w tym roku ORAZ RDNA3 to normalnie należy się spodziewać podwyżek cen (obecnych teraz oraz ergo obecnych za te 2-3 m-ce kart) w oknie przedświątecznym. Co więcej - aż się prosi (odpukać!) o jakiś pożar w fabryce / awarię kontenerowca w PRC / atak marsjan itp co by z racji chwilowego quasi-kryzysu te podwyżki odpowiednio wykręcić bardziej srogie

Prywatnie bym się nie zdziwił...

Mam lepszy pomysł. Wielki kontenerowiec blokujący kanał Sueski! A nie czekaj... to już grali... na pokładzie był Lenovo którego chciałem kupić...

To może inwazja Chin na Tajwan? Ostatnio jest między nimi ciepło, niemalże romantycznie.

-

3 minuty temu, 1234567890 napisał:

Jak chce się coś na ITX szybko to AM4, a jak przyszłościowo to AM5 bo nawet w 2028 kupisz części do tego zestawu. A intel co roku nowa podstawka

Doubt. Tak samo do Zen1 raczej nie wsadzisz ramu 3600MHz... to samo się tyczy większości płyt głównych i biosu do nich.

A zakup topowej płyty głównej obecnie to nie dość że idiotyczny wydatek to jeszcze w dalszym stopniu loteria. To już nie te czasy gdzie szło kupić Crosshaira VII Hero za 1000zł (a potem cierpieć z powodu miernego biosu...).

-

Ja używam w serwerze Athlona 3000G z customowymi ustawieniami, gdzie zablowałem TDP na poziomie 20W (przy max obciążeniu) zachowując pawie całą wydajność stocka (przy uV).

-

W dniu 3.08.2022 o 21:41, pat1441 napisał:

U mnie PBO przy < 1.2v trzyma 4,7GHz allcore.

Stock ustawienia oprócz:

PBO +100MHz, Curve negative offset -15 allcore (z lenistwa na odwal)I... w sumie tyle.

Cooler NH-D15s z jednym wentylatorem w mocno restrykcyjnej budzie (temp do 70*c dobijają).Wiem że 4.8 tez trzyma ale sprawdzałem to bez uV, dopiero jak za parę dni wrócę do domu to będę się dalej bawił.

-

1 minutę temu, wrobel_krk napisał:

Dał mnie to na sens, bo tdp już dawno nie ma sensu. 5600x ma 65w bierze 80w wielowątkowo. 5800x 5900x 5950x 105w tdp ale 140w pobiera bez OC. Widać że teraz mimo nowych procesów produkcyjnych prockow producenci napotykają barierę.

Wydajność nie rośnie bez wzrostu poboru. Zresztą dla każdego to co lubi można zrobić UV albo wyciskać 1fps przy 20w więcej.

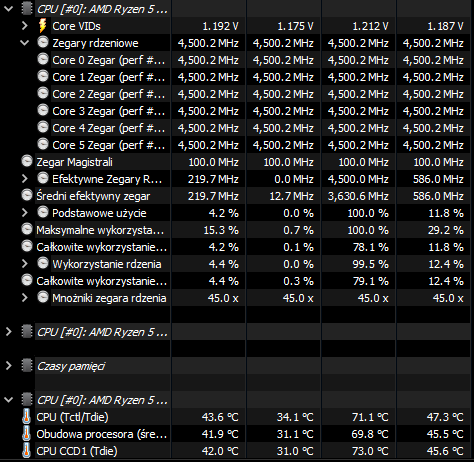

A to nie jest tak że 65W jest dla rdzeni, a 80W to bierze cały SoC? Takie wyciągam wnioski patrząc właśnie na HWInfo a akurat robię multithreadingowe rzeczy.

Imo wprowadzanie drugiego short turbo to patologia. Co mi po procku który co chwile musi się dusić?

ADD: Właśnie zapuściłem Cinebencha przy +100MHz, Curve offset -15 i Core zjadały 47W, SoC 64W.

-

23 godziny temu, Bart1278 napisał:

Bardzo polecane te dyski były

Dobrze, czy moglibyście podpowiedzieć jakąś firmę do odzysku danych ? I ile takie coś może kosztować ?

Toyoty także są bardzo polecane, a w modelu elektrycznym BZ4X odpadają koła podczas jazdy (a producent nie wie jak to naprawić i oferuje wykupy). Każdemu może podwinąć się noga - zawsze może wyjść wadliwa partia.

Tak samo myśliwce F35 - uziemione parę dni temu (wszystkie) ze względu na wadę systemu katapultacji pilota (coś z pirotechniką).Dla tego mamy systemy RAID1 jeżeli musimy trzymać dane wrażliwe.

PS: HDD ma dużo większe szanse awarii - jest to produkt pracujący "mechanicznie" i dużo bardziej wrażliwy na efekty zewnętrzne takie jak wibracje czy uderzenia.

Osobiście przytuliłem już z 30-40 dyskow SSD i żaden nie padł, nawet najstarsze TLC które były opluwane (i słusznie, bo były słabe). A dysków HDD sporo odesłałem na gwarę (konsumenckich, z Ironwolfów na razie żaden nie padł a orają 24/7)...

Co do odzyskania danych z SSD... to może się okazać trudne. HDD ma fizyczny talerz z danymi a w przypadku SSD nie mam pojęcia - istnieje ryzyko permanentnej utraty danych na logikę. Ale musisz pogooglowac i podzwonić po firmach.

-

1

1

-

-

3 minuty temu, mirai99 napisał:

Moje skille 3600 cl14 b-die mają xmp na 1.45v więc wiesz...U mnie corsair poleciał po bandzie i dał 1.35v... Może na IMC by poszło z 12700K ale nie będę jechał z DE do PL do kumpla by to sprawdzać.

To zostawiam, nie zwracam i będę monitorował sytuację.

-

10 godzin temu, mirai99 napisał:

Jak wymyślą jak chłodzić ten 3d cache...

Dadzą radę, w końcu mają na to parę lat.Mi się chyba udało ogarnąć XMP na tym Gruzenie i Corsairach. Przy 1.35v i 1.4v nie chciały chodzić... przy 1.42v nagle wydają się bootować i śmigać... wstępnie.

Czy to normalne przy gruzenach że przy XMP czasami trzeba podbić napięcie DRAM powyżej 1.4v by utrzymać 3600MHz i FLCK 1:1?

Co prawda kości 16GB czyli dual-rank...Na Intelu (12700K) i DDR4 nigdy takie cyrku nie widziałem. A B-DIE z Zen1+ śmigało jak 7 cud świata... a tutaj mam microny E-Die czy du*y nie urywa...

-

Ci co chcą niech szykują portfele. Będzie zajefajnie drogo, niedostępnie oraz z toną nowych problemów (nowa platforma).

Plus zabawa z DDR5.

Plus zabawa z DDR5.

Przez pierwsze pół roku aż wyjdzie seria update'ów do Agesa i ceny się nie ogarną to dałbym sobie spokój i traktował to jako "zwykły news".

Za to 2 generacja pod AM5 z 3D Cache będzie realnym* turbo ptysiowym upgrade. I AMD jak i vendorzy już do tego czasu rozgryzą jak się je to ciasteczko i czym się je popija.

-

1

1

-

-

1 godzinę temu, Rebelmind napisał:

Czyli dobra sztuka Ci się trafiła. Dobre OC, świetny Uv i rewelacyjny pobór przy takiej wydajności!

Muszę jutro tylko spr. czy nie mam przypadkiem biosu ustawionego na quiet. Mam strasznie niskie rpm wentylatorów przez co GPU się nagrzewa do 78*c. (hotspot 88-89). max 950-980rpm... i powerlimit 10% a wydaje mi się że powinno być 15%?

Co ciekawe temperatura nie ma wpływu na turbo... chyba że to temperatura hotspota gdyby przekroczyła 95*c miałaby wpływ (dimishing returns)?

Imo te dodatkowe MHz powyżej 2150-2250 nie są warte TDP. Przyrost nagle staje się marginalny i okupiony TDP (hałas, temperatura...).

-

Update 03.08

Witcher 3 (4K Ultra, wymaksowany ale bez blurra, v-sync & fps cap off) ok. 70fps (w testowanym miejscu):

Core cap: 2200Mhz (efektywne 2140-2180 na oko)VRAM 2150MHz + Fast timings

Powerlimit +10% (max)

Voltage: 915mV

Pobór prądu: 160W-178W

Core cap: 2300MHz (efektywne 2250-2280)

VRAM 2150Mhz + Fast timings

Powerlimit +10% (max)

Voltage: 925mV (915mV unstable)

Pobór prądu: 180-200W

Core cap: 2450MHz (efektywne lekko ponad 2400)

VRAM 2150Mhz + Fast timings

Powerlimit +10% (max)

Voltage: 925mV

Pobór prądu 220-240W

Wiecie jakie były różnice w fps? 2 oraz 1 względem najwyższego OC... przy ponad 70. A róznica w TDP? Nawet 70-80W momentami!

160W przy 4K i 16GB prądożernego GDDR6? Wybitny wynik, z 10W-20W powyżej topowych GPU Nvidii w laptopach (pamiętam jak moje 980M na vbiosie Premy zjadały 180W...).

Przy 2160p zegary zawsze są dużo niższe niż w przypadku 1440p* (nawet 100Mhz) - należy to wziąć pod uwagę. OC w niższych rozdziałkach "w teorii" dałoby więcej Mhz - ale niekoniecznie z realnym przyrostem fps. Na 2070S FTW3 po OC miałem od 90 do 130Mhz różnicy między 1440p a 2160p przy tych samych ustawieniach i powerlimicie.PS: nie sprawdzałem jeszcze max OC przy pełnym napięciu 1.025v.

-

1

1

-

-

9 minut temu, Wik-Mar napisał:

Może ten filmik pomoże ci a w szczegulności odzyskać 23 do 47% wydajności.

(2) Mroczny sekret RADEON Software... Odzyskaj 23-47% wydajności! [Po Przepięciu #1] - YouTube

Wczoraj to sprawdzałem, przynajmniej na najnowszych driverach tego nie zaobserwowałem. Jeżeli autor aktualizuje sterowniki to raczej nie powinien mieć tego problemu.

-

1

1

-

-

Wszedłem do biosu by zmienić krzywą wentylatorów bez innych zmian i znów XMP nie działa... coś mnie strzeli zaraz. VSOC voltage i DRAM Voltage, mnożnik itp też spr i ustawiłem ręcznie...

Post 2:

Zacząłem sprawdzać kości 1-by-1...

na pierwszej XMP działa aż miło, na drugiej za cholerę nie chce bootować...

Post3:

"Słabsza" kość często okazuje się niestabilna przy bootowaniu nawet przy minimalnych zmianach. Ale na 2666MHz (stock bez XMP) jest stabilna, jak już jej przejdą fochy z bootowaniem... -

Ja kupiłem teraz. Można dorwać bardzo fajne oferty, na tyle dobre że nie będzie to bolało potem i nie trzeba będzie tego żałować. Ale to moja subiektywna opinia. Potem może być... różnie.

-

1

1

-

-

Wstępnie pograłem chwilę w HLL (2160p, Ultra, blurr-off).

80fps bez dropów (spodziewałem się... 40-50?).

Resizable bar enabled.GPU Temp Max: 75,0*c

Hotspot: 90*c

Max fan speed odnotowany: 1623rpm

Pobór mocy (max): 220,37W

VRAM used (max): 11,157MB

Wstępnie bez żadnych tweaków. Wentylatory w budzie na sztywno na 800rpm (Define 7 Compact, restrykcyjna buda), x3 front + x1 bottom intake (P12 Arctica)

-

1

1

-

1

1

-

-

Odziwo już zaskoczyło, samo. Nie wiem o co kaman. Najwyżej pobawię się SocVCore.

47 minut temu, Rebelmind napisał:Bo to Gigabyte?

Still better than ASS'Us.

-

Ma ktoś pomysł czemu XMP nie działa na B550 Aorus Elite AX V2? (3600MHz)

Zaktualizowałem nawet bios z F14 na F16c i nadal qpa...

-

3 godziny temu, Rebelmind napisał:

Ta, kiedyś u nich kupowałem all graty do PC (np. Crosshaira, Zen1+, BDIE ram). Od lat unikam tego sklepu - sprzedają często rzeczy bez gwarancji, bardzo problematyczna obsługa i nie przestrzegają praw konsumenta. Zwrócisz produkt (przysługuje w ramach prawa), nawet taki za 2€ nierozpakowany... dostaniesz maila z info że "sklep rezygnuje ze współpracy z tobą" i banują ci konto.

Mi się trafiło all z gwarancją itp (weryfikowałem). Ale sporo osób od tamtej pory od 2020 roku nacięło się tam srogo... w tym na GPU. Ja swoje graty brałem do 2018-2019 jak jeszcze było tip-top. Coś się zmieniło ze sklepem albo padają.Te ceny tam są jak cyrograf albo lotto. Za swojego 6800 Pulse, którego właśnie wsadziłem do budy dałem 679€ (składam kompa mając 2 ręce w bandażach... bardzo głeboko pociąłem się wczoraj... w sposób mega kretyński) i idzie mi to jak krew z nosa. Zaraz 1st boot.

-

6 godzin temu, Rebelmind napisał:

Ale szto ty haciejesz łot 12700k? Tosz tj imho najlepszy Cpu do gier obecnie (cena, wydajność, temperatury) - i gdyby był ~70$ tańszy to byłby i najbardziej opłacalnym

Hajceje to kretyńskie TDP. Gdyby po UV ten procek żarł 90-100W a nie 160 to uznałbym jego potęgę i władzę nad Posępnym Czerepem, ale tak nie jest ;x

Nie uznaje progressu poprzez patologiczne podnoszenie TDP. A Intel od dawna tylko to potrafi robić... ostatni cep z którego się cieszyłem z ich stajni to był 6700K, i to dopiero po delidzie. -

W DE miesiąc temu 3060Ti stał prawie na równi z 3060. Wtedy 3060 Ti was de wey.

Ale teraz w DE np. 3060 nagle tak spadły, gdzie 3060Ti stoi w miejscu że to Ti nie ma sensu. Wszystko rozbija się o oczekiwaną wydajność, TDP oraz perf per pln.

Osobiście uważam że ogólnie* Ti jest bardziej udaną wersją ale zależy za ile siana względem 3060.

Szukałbym obu. Jak trafi się jakaś wybitna oferta to wtedy brać bez wyrzutów którąkolwiek. -

A czyli to nie PL2 jest problemem, tylko po prostu tyle żre przy takim napięciu.

Jeszcze nie najgorzej, ale ciągle sporo.

Nie mogę się doczekać aż jutro dostanę w swoje łapy własnego 5600X i ile wyciśnie W na stocku z rozsądnym uV.

Po 12700K mam PTSD. Nawet po UV to jest cholerny Admiral Kuznetsov w erze reaktorów atomowych.

-

39 minut temu, Rebelmind napisał:

12600k ma długotrwały limit 120W, którego max udało mi się przekroczyć o 16W

Powinieneś móc zwiększyć PL2 bez problemu, nawet w laptopie mogę to zrobić. Still it's aloot i to pewnie po optymalizacji napięcia

-

13 godzin temu, Rebelmind napisał:

Plotki, ploteczki, przecieki nt Zen4:

Kolejna próbka R5 7600x przetestowana z wynikami w bazie UserBench.

"6 cores, 12 threads

Base clock 4.4 GHz, turbo 4.95 GHz (avg)"

Wyniki? SC 20% wyższy od średniego wyniku 12900k, 55% wyższy od 5600x. W teście MC już tylko jednak 23% szybsza od Zen3.

Imo spodziewałem się większego skoku...

Skoro 7600X ma mieć aż 120W TDP na booście według wielu źródeł... słabo. Dawać Zen6.

(iGPU pewnie samo w sobie dodaje parę watów)

Temat ogólny o prockach AMD

w Procesory i płyty główne

Napisano

Dobrze że gram w 4K, tutaj nawet 5600X na uV się nudzi. Wczoraj grałem w TW:WH3 w tle renderując video 1080p...

Ceny zwykłych Gruzenów 3 spadły tak bardzo przez ostatnie pół roku że nie dość że dominują perf per W to jeszcze perf per € jest królewski.

Jasne, nie wymaxujemy fps jak na Intelu przy 180fps itp ale dla 99,999998% ludzi to będzie wystarczające.

Ja mam radochę z swojego nowego buildu - Zen3 + RDNA2. Oba po UV i watomierz pokazuje max* 300W. W 2160p (testowane bez vsync czy limitera fps)

Kumpel z 12700K i RTX 3070 ma 510-540W... i safari w pokoju. Dramat.

Ba, podnieśli mu teraz prąd o prawie 200% na nowej umowie.

3D jest spoko ale ja z tym czekam na 2 generację pod AM5 - wtedy przytulę. Teraz i tak jak wyjdzie Zen4 to można się spodziewać że zabraknie nawet RAMu DDR5... którego specyfikacja (wczesna faza cyklu życia) jest zazwyczaj mierna. I ciągle wysokie ceny...

No i przebajerzone mobasy pod AM5. Jak patrze specyfikację drugi dzień różnych modeli to zadaje sobie pytanie "po co" w kwestii większości VRM czy bajerów. A cena dziurawi sufit. Robią to samo co Intel...

Wracając do ITX bo się rozkręciłem... przez perf per W dla ITX wybrałbym Zen3 (5600X lub max 5800X). Mobasy są, ceny akceptowalne, dobry perf per watt oraz skalowanie... można złożyć bezstresowo małą skrzynkę. RAM 3600Mhz low-profile tez jest ogólnodostępny (ja mam teraz corsairy lpx).